Efficient AI

Блок 3. Языковые модели. Трансформер

Где мы?

- 📍Вводная

- Блок 1

- Блок 2

- 🫠

- 🏝️1 мая

- 🌹9 мая

- Блок 3

- ☠️Экзамен

Содержание

- Задача моделирования языка

- Инфраструктура и приложения

- Архитектура модели: трансформер

- Производительность и узкие места

Задача моделирования языка

$$ P(\omega_0,\omega_1,\omega_2,\ldots,\omega_s)=P(\omega_0)P(\omega_1|\omega_0)P(\omega_2|\omega_0,\omega_1)\ldots $$

Задача моделирования языка

$$ P(\text{token}_i) = \frac{e^{\frac{\text{logit}_i}{T}}}{\sum_j e^{\frac{\text{logit}_j}{T}}} $$

Задача моделирования языка

Инфраструктура и приложения

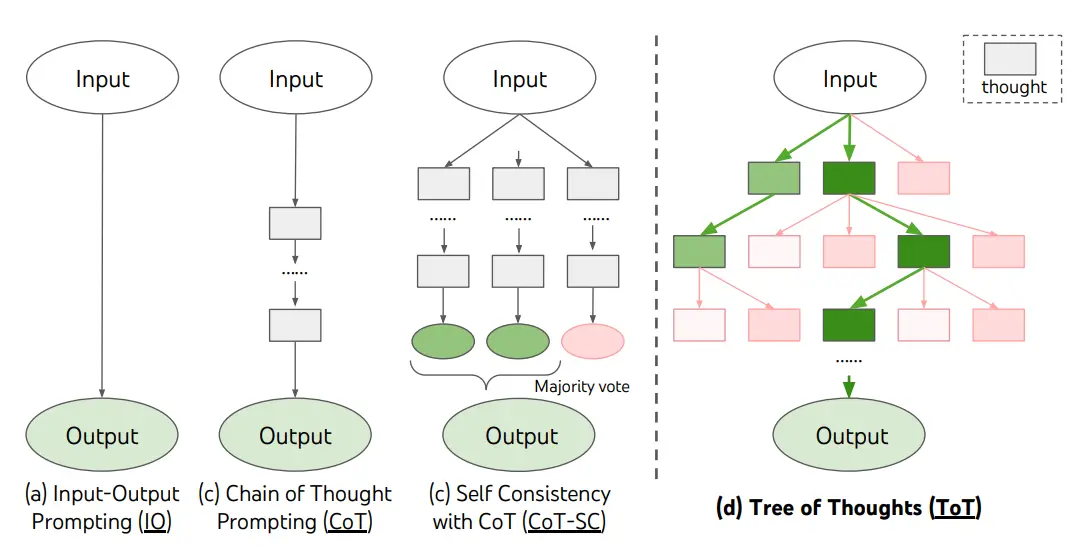

- Zero-shot Prompting

- Few-shot Prompting

- Chain-of-Thought (CoT) Prompting

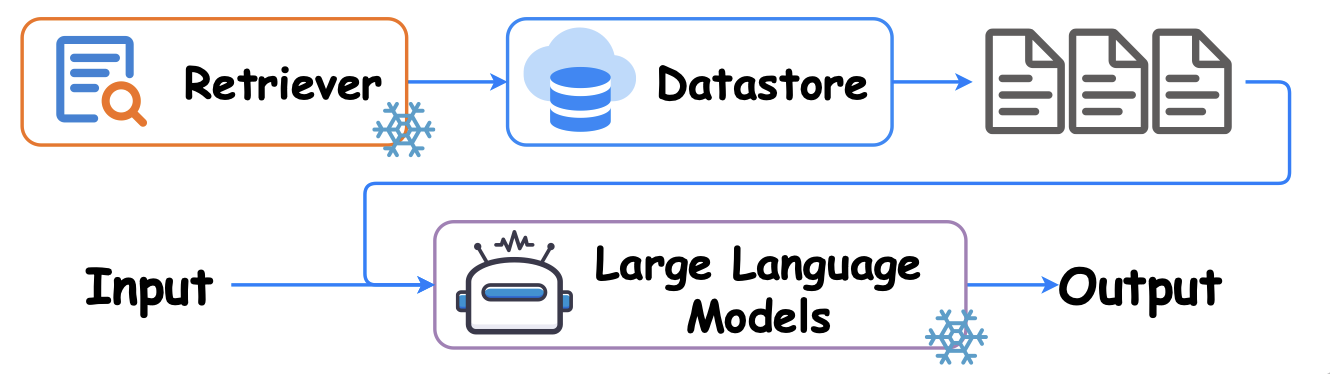

Инфраструктура и приложения

Инфраструктура и приложения

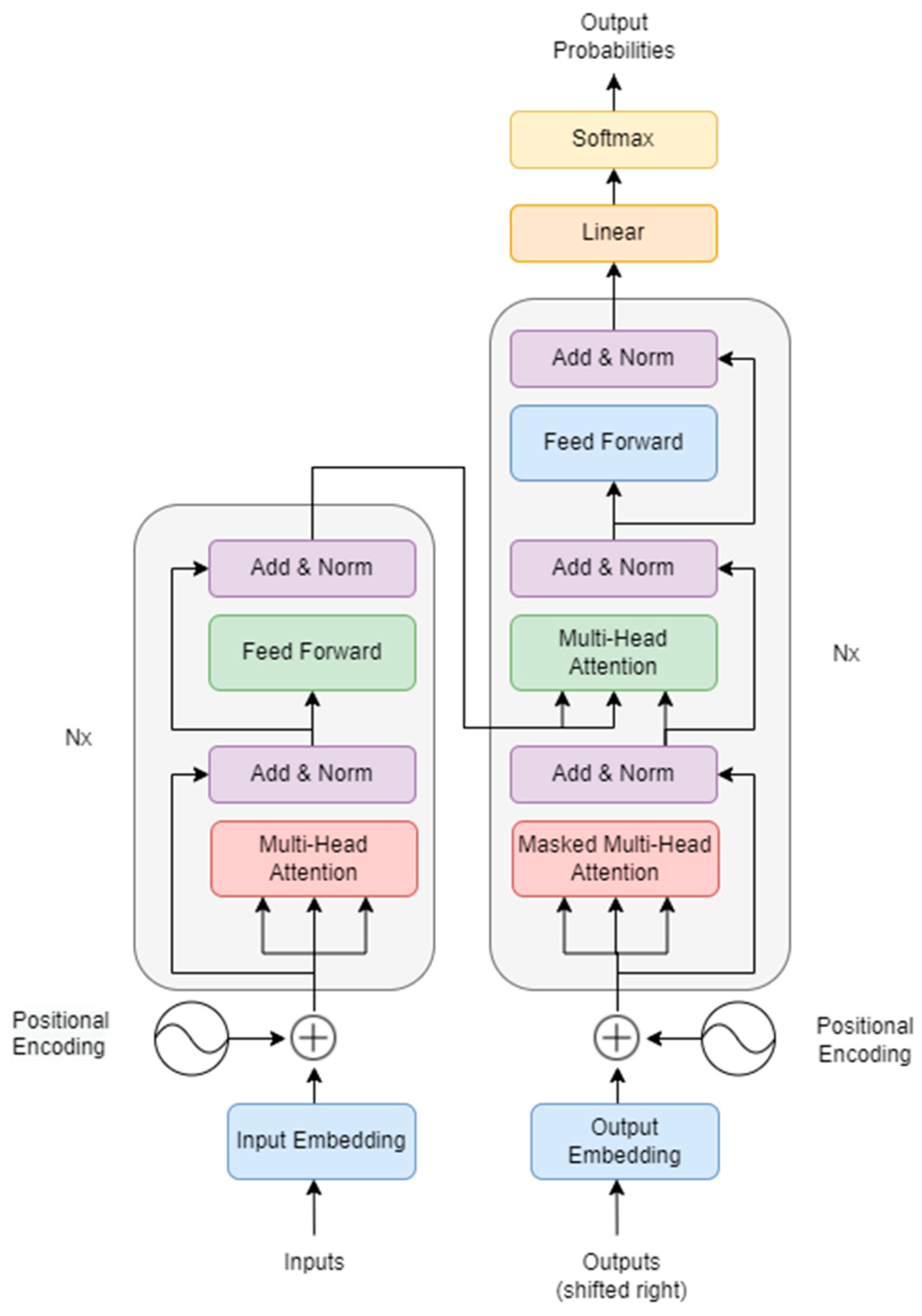

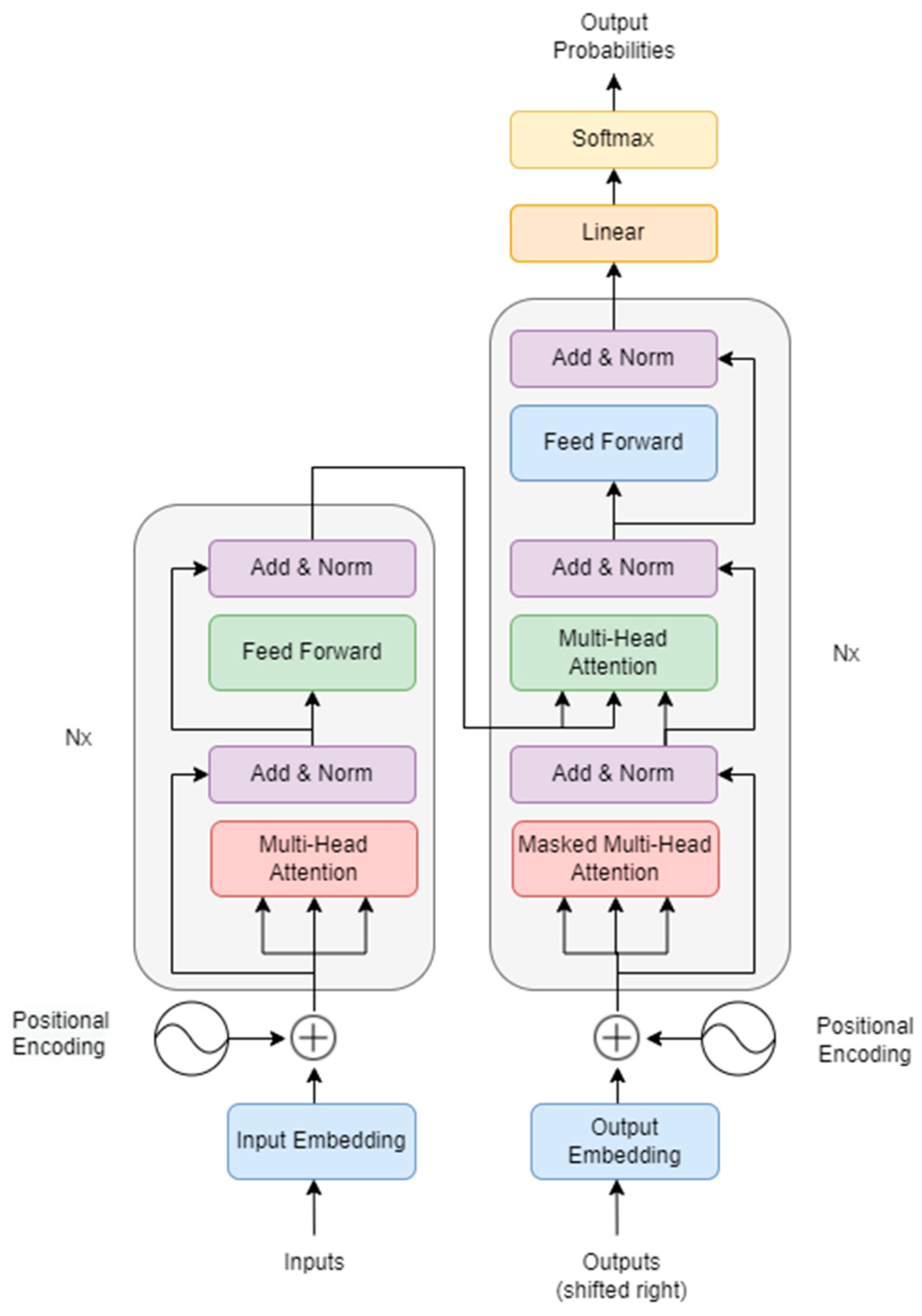

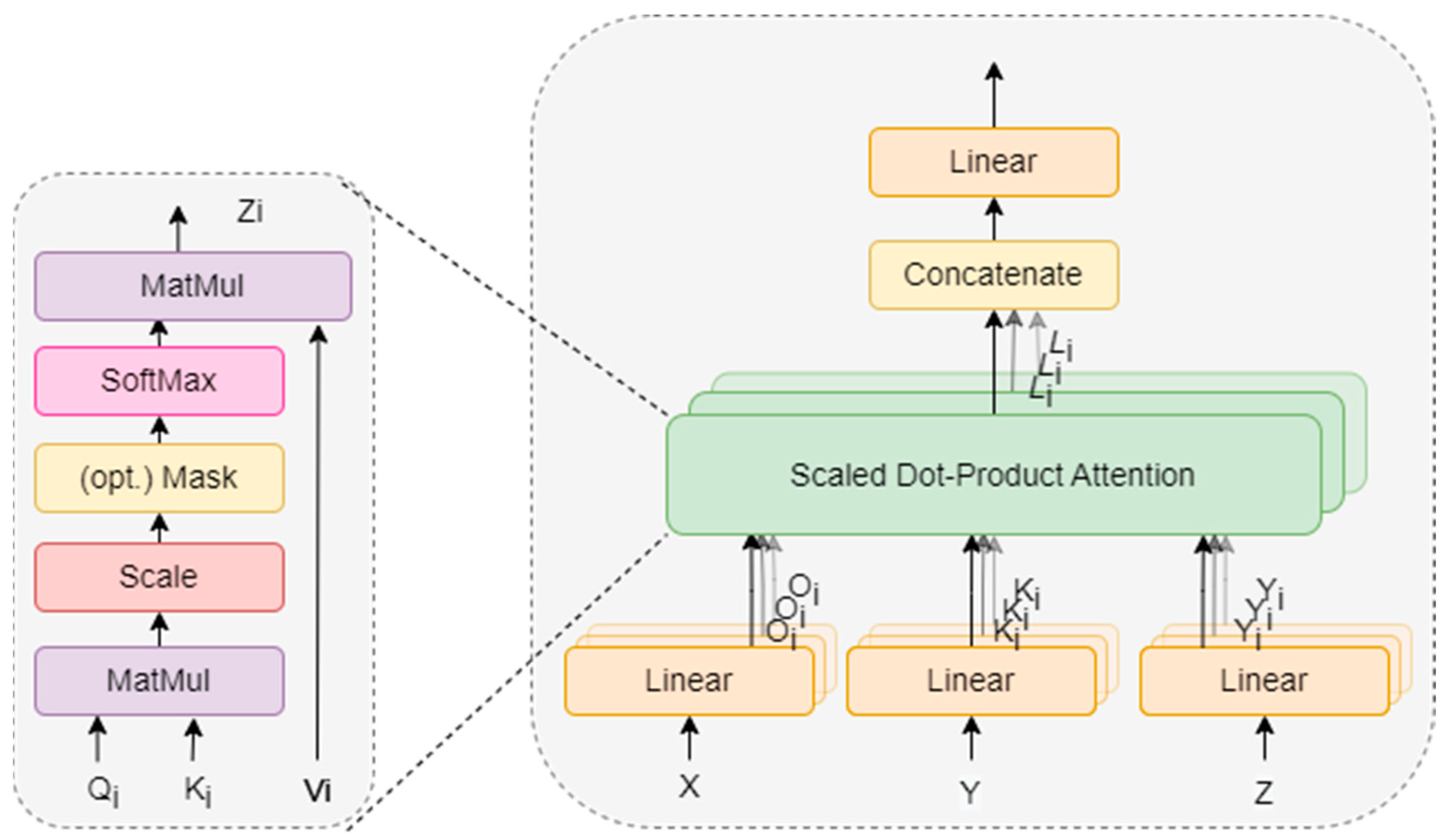

Архитектура модели: трансформер

Архитектура модели: трансформер

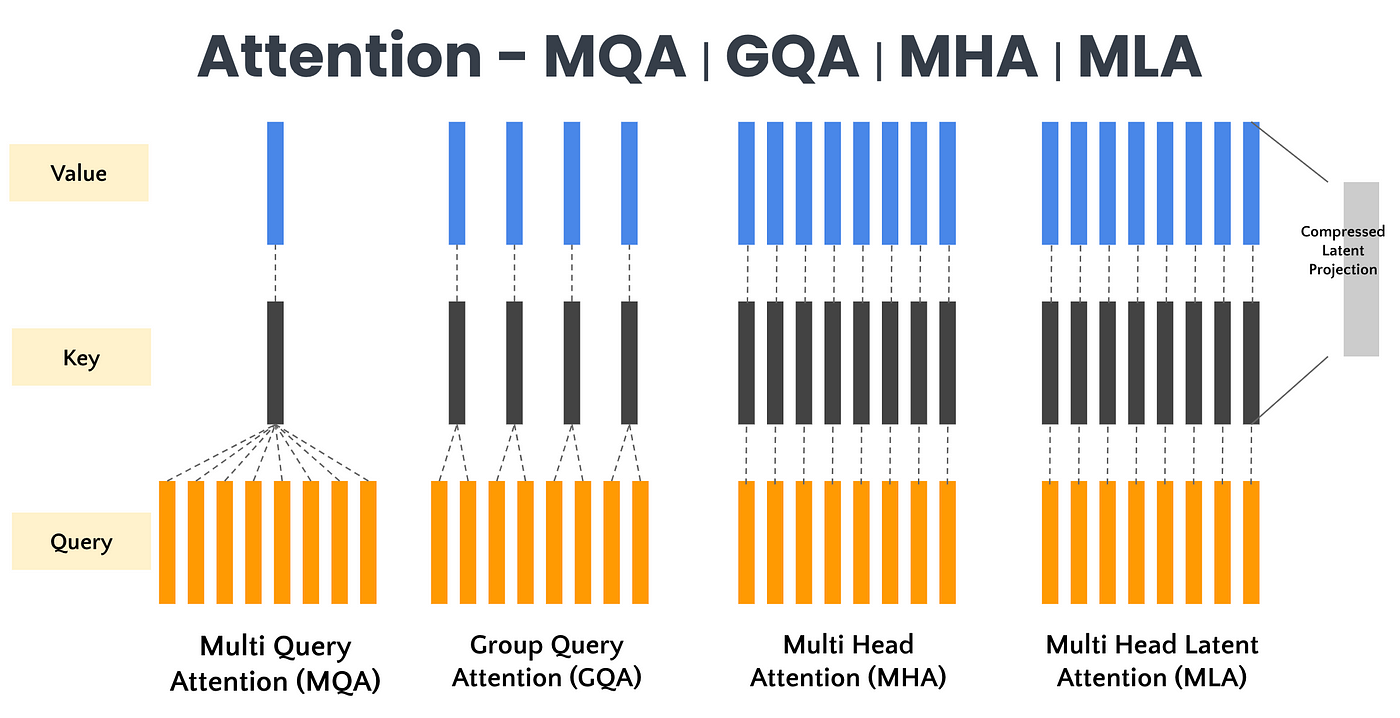

Архитектура модели: трансформер

Архитектура модели: трансформер

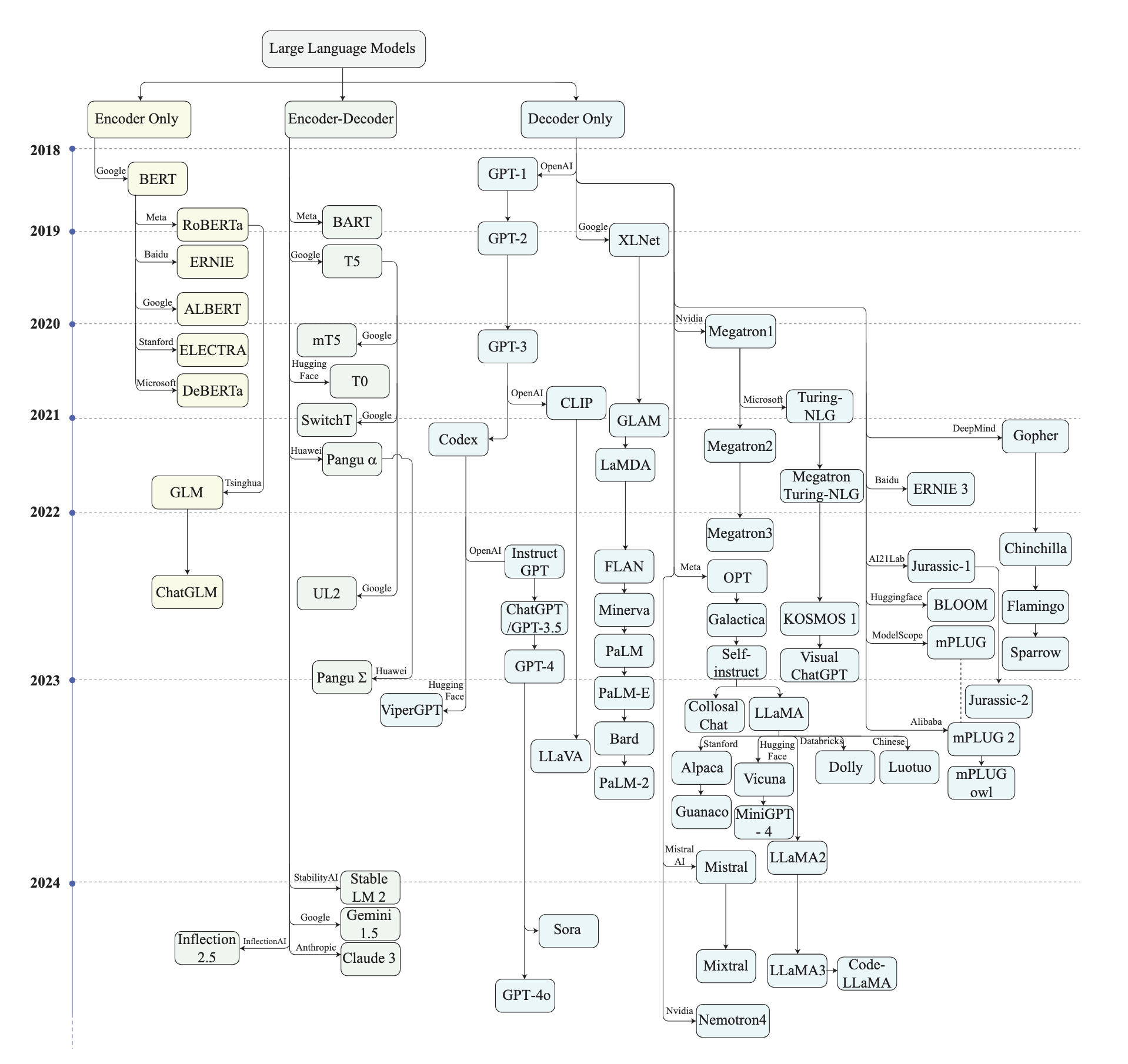

Архитектура модели: семейства

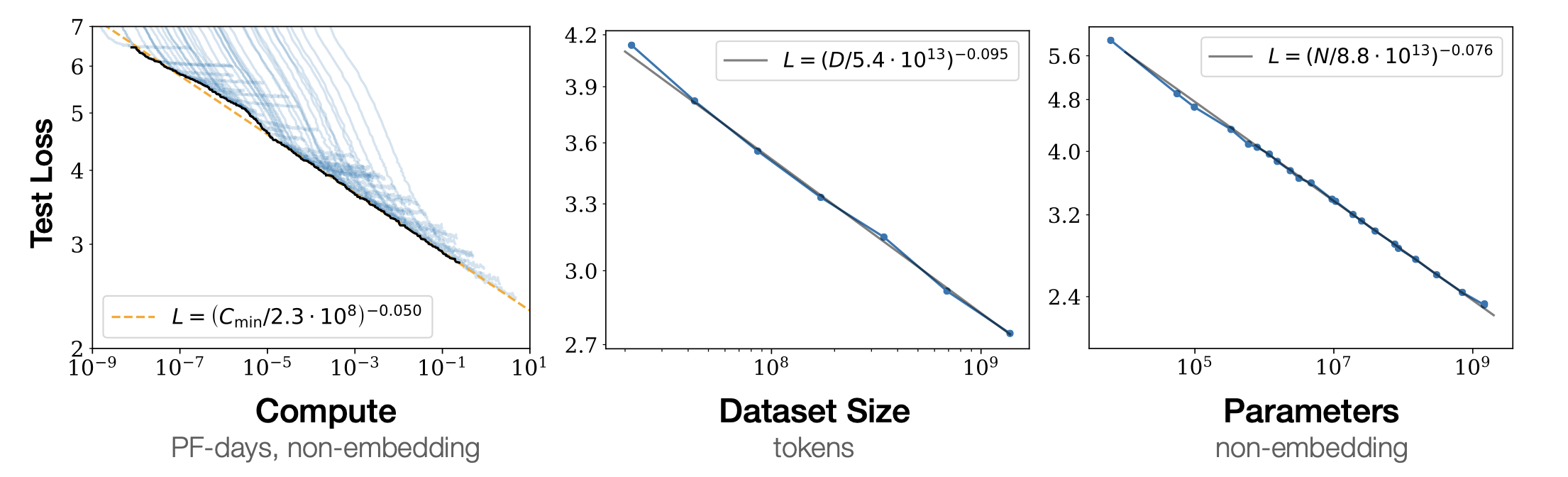

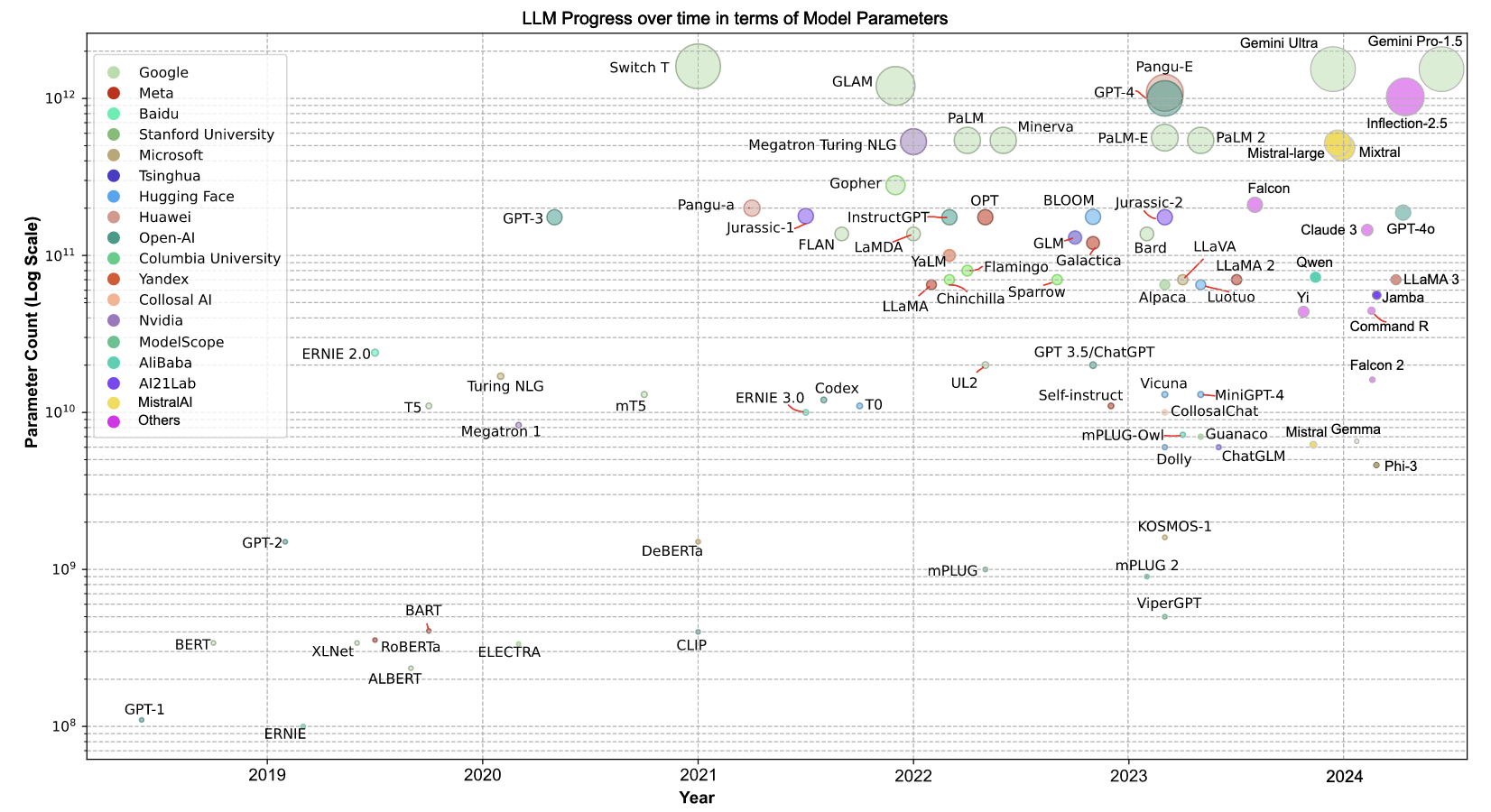

Архитектура модели: размеры

Перерыв

Узкие места